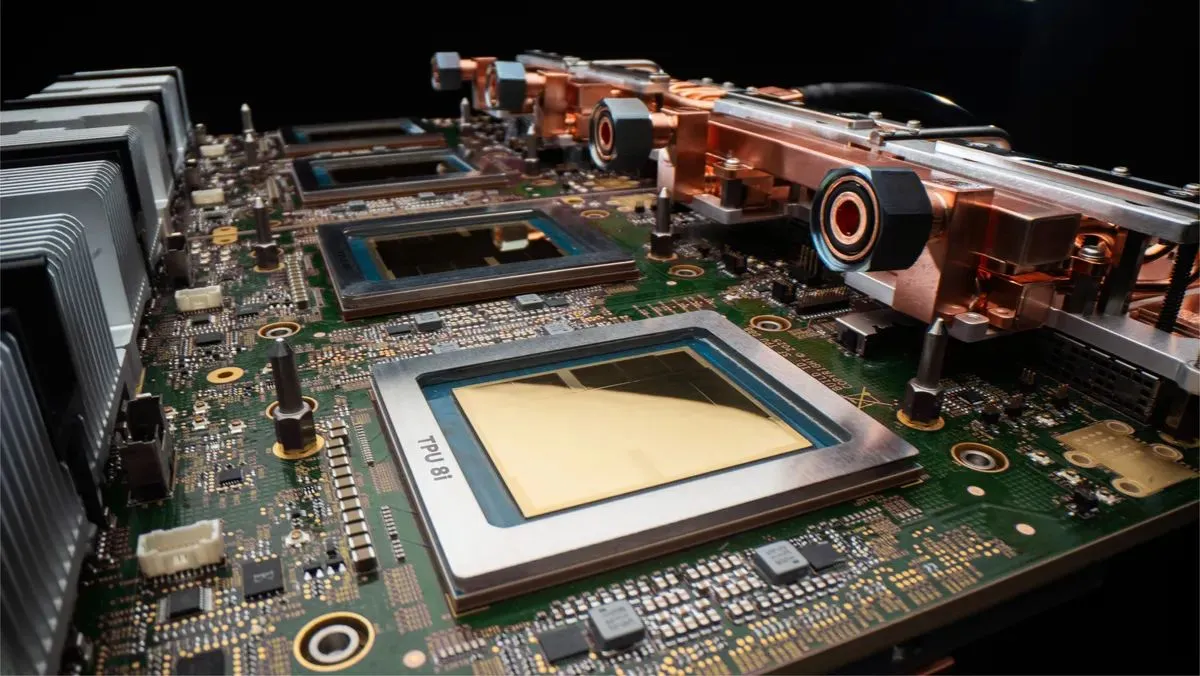

सर्च दिग्गज का कहना है कि इन्हें विशेष रूप से AI प्रशिक्षण (TPU 8t) और अनुमान (TPU 8i) और Google DeepMind के साथ काम करने के लिए डिज़ाइन किया गया है।

एआई और इन्फ्रास्ट्रक्चर के लिए Google के मुख्य प्रौद्योगिकीविद् अमीन वाहदत लिखते हैं, “ये दो चिप्स हमारे कस्टम-निर्मित सुपर कंप्यूटरों को अत्याधुनिक मॉडल प्रशिक्षण और एजेंट विकास से लेकर बड़े पैमाने पर अनुमान कार्यभार तक सब कुछ संचालित करने के लिए डिज़ाइन किए गए हैं।”

एआई और इन्फ्रास्ट्रक्चर के लिए Google के मुख्य प्रौद्योगिकीविद् अमीन वाहदत लिखते हैं, “ये दो चिप्स हमारे कस्टम-निर्मित सुपर कंप्यूटरों को अत्याधुनिक मॉडल प्रशिक्षण और एजेंट विकास से लेकर बड़े पैमाने पर अनुमान कार्यभार तक सब कुछ संचालित करने के लिए डिज़ाइन किए गए हैं।”

“टीपीयू वर्षों से जेमिनी सहित अग्रणी फाउंडेशन मॉडल को शक्ति प्रदान कर रहे हैं। ये 8वीं पीढ़ी के टीपीयू एक साथ प्रशिक्षण, सेवा और एजेंटिक कार्यभार में पैमाने, दक्षता और क्षमताएं प्रदान करेंगे।”

घोषणा Google क्लाउड नेक्स्ट ’26 में की गई थी, लेकिन तकनीकी विवरण दुर्लभ हैं।

टीपीयू 8टी

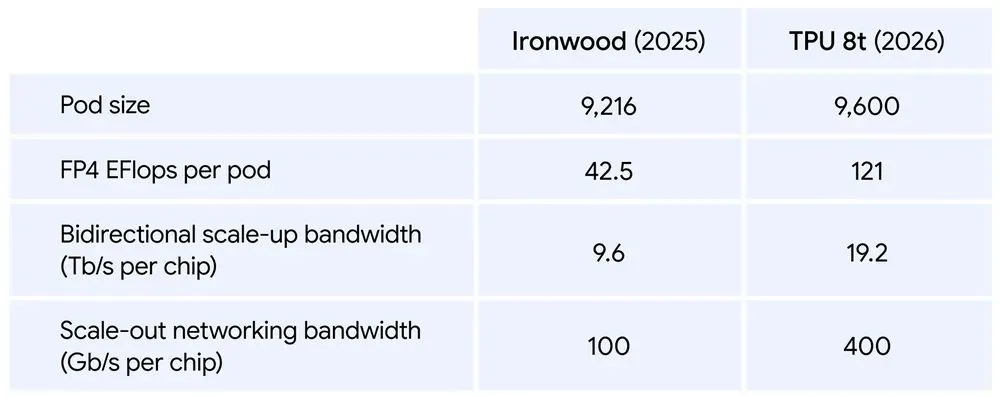

Google का कहना है कि एक एकल TPU 8t सुपरपॉड (64 बोर्डों का एक अनुकूलित नेटवर्क) अब 9,600 चिप्स और दो पेटाबाइट साझा उच्च बैंडविड्थ मेमोरी तक पहुंच गया है। यह पिछली पीढ़ी की तुलना में दोगुनी इंटरचिप बैंडविड्थ के साथ है। इसमें कहा गया है कि आर्किटेक्चर 121 एक्साफ्लॉप्स कंप्यूट प्रदान करता है, जो सबसे जटिल मॉडल को मेमोरी के एकल, विशाल पूल का उपयोग करने की अनुमति देता है।

यह कंपनी का भी उपयोग करता है कन्या नेटवर्कजो JAX और Pathways सॉफ़्टवेयर के साथ एक AI-उन्मुख नेटवर्किंग सिस्टम है। इसका मतलब है, Google का कहना है, TPU 8t एक एकल तार्किक क्लस्टर में दस लाख चिप्स तक के लिए निकट-रेखीय स्केलिंग प्रदान कर सकता है।

TPU 8t और इसके पूर्ववर्ती, कोडनेम आयरनवुड की तुलना नीचे दिखाई गई है।

टीपीयू 8आई

TPU 8i के संदर्भ में, AI अनुमान के लिए, Google बताता है कि सिस्टम पिछली पीढ़ी की तुलना में प्रति पॉड लगभग 3x कंप्यूट प्रदर्शन प्रदान करता है।

विवरण में शामिल है कि TPU 8i में 384MB ऑन-चिप SRAM के साथ 288 जीबी हाई-बैंडविड्थ मेमोरी है। यह पिछली पीढ़ी की तुलना में 3 गुना अधिक है, और एक मॉडल के सक्रिय कामकाजी सेट को पूरी तरह से ऑन-चिप पर रख सकता है।

Google का यह भी कहना है कि उसने अपने कस्टम एक्सियन आर्म-आधारित सीपीयू की ओर बढ़ते हुए, प्रति सर्वर भौतिक सीपीयू होस्ट को दोगुना कर दिया है।

वाहदत कहते हैं, “अलगाव के लिए एक गैर-समान मेमोरी आर्किटेक्चर (एनयूएमए) का उपयोग करके, हमने बेहतर प्रदर्शन के लिए पूरी प्रणाली को अनुकूलित किया है।”

आधुनिक मिक्सचर ऑफ़ एक्सपर्ट (MoE) मॉडल के लिए, Google का कहना है कि उसने इंटरकनेक्ट (ICI) बैंडविड्थ को दोगुना कर 19.2 Tb/s कर दिया है। इसके नए बोर्डफ्लाई आर्किटेक्चर का लक्ष्य “अधिकतम नेटवर्क व्यास को 50% से अधिक कम करना है, यह सुनिश्चित करना कि सिस्टम एक एकजुट, कम-विलंबता इकाई के रूप में काम करता है”।

एक नया ऑन-चिप कलेक्टिव एक्सेलेरेशन इंजन (सीएई) वैश्विक संचालन को ऑफलोड करता है, अंतराल को कम करने के लिए ऑन-चिप विलंबता को 5x तक कम करता है।

आप इस Google पर और अधिक पढ़ सकते हैं ब्लॉग भेजा.

टीपीयू2

2017 में Google ने अपनी दूसरी पीढ़ी के TPU, TPU2 की घोषणा की, जो अब अपेक्षाकृत मामूली 45Tflops प्रदान करता है।

चार TPU2s वाला एक सिस्टम बोर्ड 180Tflops और 64 बोर्डों का एक अनुकूलित नेटवर्क, जिसे TPU पॉड कहा जाता है, 11.5 पेटाफ्लॉप्स प्रदान करेगा।

हमारी सभी Google सामग्री देखें.