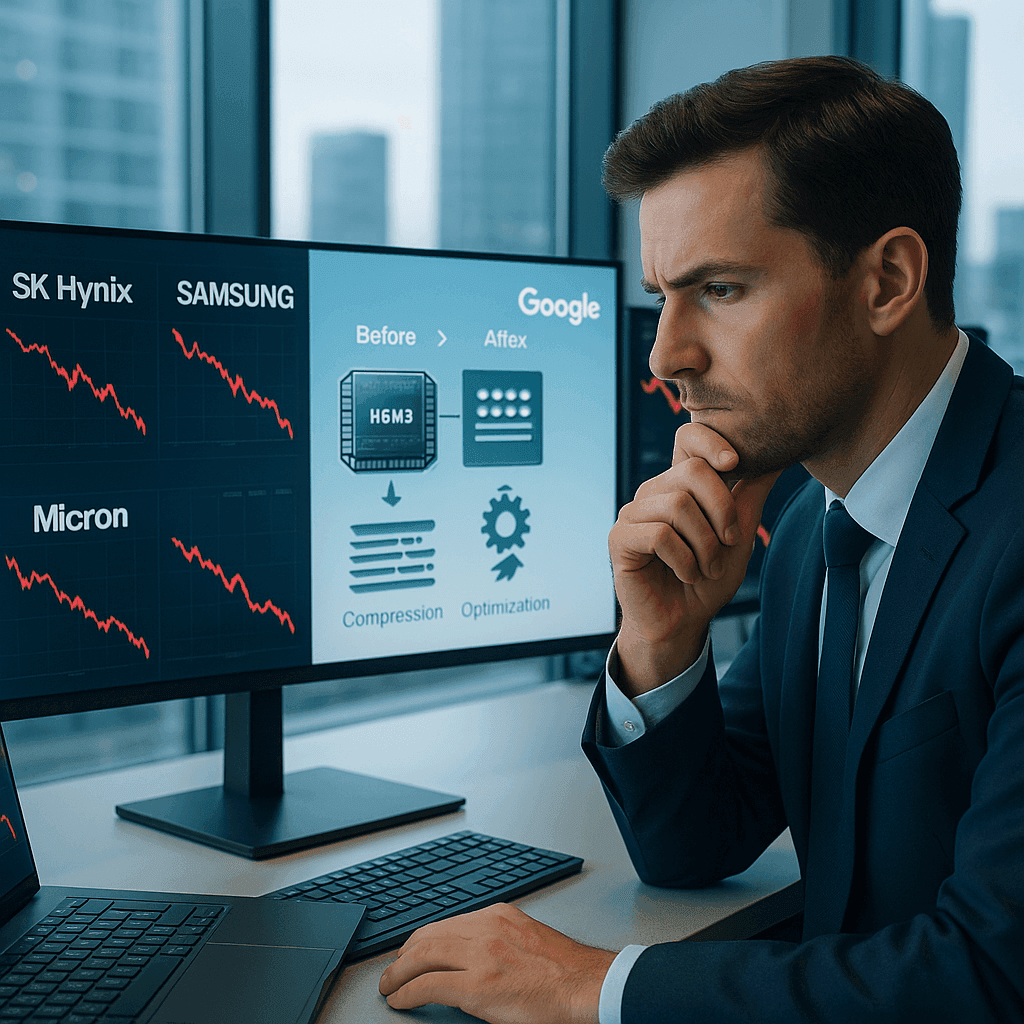

Google द्वारा TurboQuant के अनावरण के बाद मेमोरी चिप स्टॉक में भारी गिरावट आई है, एक AI सफलता जो बड़े भाषा मॉडल के लिए मेमोरी आवश्यकताओं को छह गुना तक कम कर सकती है। एसके हाइनिक्स, सैमसंग और माइक्रोन के शेयरों में गुरुवार को तेजी से गिरावट आई क्योंकि निवेशक भविष्य में कीमतों की ओर बढ़ रहे हैं, जहां एआई इंफ्रास्ट्रक्चर बहुत कम उच्च-बैंडविड्थ मेमोरी चिप्स की मांग करता है – वही उत्पाद जिन्होंने सेमीकंडक्टर उद्योग के हालिया उछाल को बढ़ावा दिया है।

गूगल अभी-अभी एक बम गिराया है जो सेमीकंडक्टर उद्योग में गूंज रहा है। टेक दिग्गज की नई टर्बोक्वांट तकनीक एआई मॉडल की मेमोरी फ़ुटप्रिंट को नाटकीय रूप से कम करने का वादा करती है, और निवेशक यह देखने के लिए इंतजार नहीं कर रहे हैं कि यह कैसे काम करता है। वे पहले बेच रहे हैं और बाद में सवाल पूछ रहे हैं।

के शेयर एसके हाइनिक्स, SAMSUNGऔर माइक्रोन गुरुवार की सुबह सभी में गिरावट आई क्योंकि व्यापारियों ने Google की घोषणा के निहितार्थ को पचा लिया। बिकवाली एक कठोर वास्तविकता को दर्शाती है: यदि एआई सिस्टम को संचालित करने के लिए अचानक छह गुना कम मेमोरी की आवश्यकता होती है, तो चिप निर्माताओं की कमाई को प्रभावित करने वाली विस्फोटक मांग वृद्धि किसी की भी अपेक्षा से अधिक तेजी से लुप्त हो सकती है।

मेमोरी चिप क्षेत्र के लिए समय इससे अधिक अनिश्चित नहीं हो सकता। एसके हाइनिक्स और सैमसंग जैसी कंपनियों ने उच्च-बैंडविड्थ मेमोरी उत्पादन सुविधाओं में अरबों का निवेश किया है, यह शर्त लगाते हुए कि तेज, अधिक क्षमता वाले चिप्स के लिए एआई की अतृप्त भूख वर्षों तक जारी रहेगी। विशेष रूप से एसके हाइनिक्स ने एआई डेटा केंद्रों में एचबीएम (हाई-बैंडविड्थ मेमोरी) की बिक्री बढ़ने के कारण पिछले साल अपने स्टॉक में बढ़ोतरी देखी है। अब उस थीसिस का वास्तविक समय में तनाव-परीक्षण किया जा रहा है।

ऐसा प्रतीत होता है कि Google की TurboQuant तकनीक यह अनुकूलित करके काम करती है कि AI मॉडल अनुमान के दौरान वज़न कैसे संग्रहित और पुनः प्राप्त करते हैं – प्रतिक्रियाएँ उत्पन्न करने की प्रक्रिया। पारंपरिक बड़े भाषा मॉडल को अरबों मापदंडों को तैयार रखने के लिए भारी मात्रा में मेमोरी की आवश्यकता होती है। उन्नत परिमाणीकरण तकनीकों को लागू करके, टर्बोक्वांट मॉडल प्रदर्शन से समझौता किए बिना इन मापदंडों को कहीं अधिक कुशलता से संपीड़ित करता है। परिणाम एआई सिस्टम है जो हार्डवेयर के एक अंश पर चल सकता है।

डेटा सेंटर ऑपरेटरों और क्लाउड प्रदाताओं के लिए, यह एक संभावित सोने की खान का प्रतिनिधित्व करता है। एआई सर्वर कॉन्फ़िगरेशन में मेमोरी चिप्स सबसे महंगे घटकों में से हैं, जो अक्सर कुल सिस्टम लागत का 30-40% हिस्सा होते हैं। बड़े पैमाने पर एआई को तैनात करने वाले हाइपरस्केलर्स के लिए मेमोरी आवश्यकताओं में छह गुना की कमी से करोड़ों की बचत हो सकती है। लेकिन किसके लिए अच्छी खबर है , और अन्य क्लाउड दिग्गज चिप निर्माताओं के लिए अस्तित्व संबंधी भय है।