चैटजीपीटी हेल्थ जैसे नए एआई टूल का वादा आकर्षक है: सार्थक अंतर्दृष्टि प्राप्त करने के लिए ऐप्पल वॉच जैसे उपकरणों से वर्षों के व्यक्तिगत स्वास्थ्य डेटा का विश्लेषण करने की क्षमता। लेकिन जब आप इस सिद्धांत को व्यवहार में लाते हैं तो क्या होता है?

जेफ्री ए. फाउलर, तकनीकी स्तंभकार वाशिंगटन पोस्टजानने को उत्सुक था। उन्होंने नए टूल को एक दशक के डेटा तक पहुंच प्रदान की – जिसमें उनके ऐप्पल हेल्थ ऐप में संग्रहीत 29 मिलियन कदम और 6 मिलियन दिल की धड़कन माप शामिल हैं। फिर उन्होंने बॉट से उनके स्वास्थ्य, विशेष रूप से उनके हृदय स्वास्थ्य का मूल्यांकन करने के लिए कहा।

बॉट ने उसे सीधा छक्का (अमेरिकी प्रणाली के अनुसार एफ, यानी, सबसे खराब संभावित रेटिंग) दिया।

फाउलर ने अपने लेख में लिखा है, ”मैं घबरा गया और जॉगिंग करने चला गया।” फिर उसने चैटजीपीटी रिपोर्ट अपने असली डॉक्टर को भेजी। उनकी प्रतिक्रिया कहीं अधिक आश्वस्त करने वाली थी: फाउलर को दिल का दौरा पड़ने का जोखिम वास्तव में इतना कम है कि उनकी बीमा कंपनी शायद एआई को खारिज करने के लिए एक अतिरिक्त परीक्षण के लिए भी भुगतान नहीं करेगी।

ChatGPT हेल्थ: “यह किसी भी चिकित्सीय सलाह के लिए तैयार नहीं है।”

जब फाउलर ने एआई से अपने दिल के स्वास्थ्य का फिर से आकलन करने के लिए कहा, तो फैसला नाटकीय रूप से बदल गया। अचानक यह “4” (डी) हो गया। वह पूछता रहा और ग्रेड को “6” (एफ) और “2” (बी) के बीच उतार-चढ़ाव होते देखता रहा। पत्रकार ने चिकित्सा में एआई के विशेषज्ञ, हृदय रोग विशेषज्ञ एरिक टोपोल को परिणाम दिखाए। उनका फैसला स्पष्ट था:

यह निराधार है. यह किसी भी चिकित्सीय सलाह के लिए तैयार नहीं है।

टोपोल रेटिंग में मनमाने उतार-चढ़ाव के बारे में भी उतने ही कठोर थे: इस प्रकार की यादृच्छिकता “पूरी तरह से अस्वीकार्य” है।

खतरा स्पष्ट है: ऐसे अत्याधुनिक उपकरण स्वस्थ लोगों में अत्यधिक चिंता पैदा कर सकते हैं या, इसके विपरीत, वास्तविक स्वास्थ्य समस्याओं वाले लोगों को सुरक्षा की झूठी भावना में डाल सकते हैं।

ग़लत व्याख्या: डेटा के कारण AI अक्सर विफल क्यों हो जाता है?

चैटजीपीटी के त्रुटिपूर्ण विश्लेषण के विशिष्ट कारण थे। सबसे पहले, AI ने अपना नकारात्मक मूल्यांकन VO2 अधिकतम मूल्य पर आधारित किया। हालाँकि, Apple स्वयं इस मान को केवल “अनुमान” के रूप में संदर्भित करता है, और स्वतंत्र शोधकर्ताओं ने पाया कि ये अनुमान औसतन 13 प्रतिशत बहुत कम हो सकते हैं।

दूसरे, एआई ने फाउलर की विश्राम हृदय गति में उतार-चढ़ाव को चिंताजनक स्वास्थ्य संकेतों के रूप में व्याख्यायित किया और उन्हें “उल्लेखनीय वृद्धि” के बारे में अपने डॉक्टर से बात करने की सलाह दी। ऐसा करने में, इसने एक महत्वपूर्ण कारक को नजरअंदाज कर दिया: परिवर्तन हमेशा तब होते थे जब पत्रकार को बेहतर सेंसर के साथ एक नया ऐप्पल वॉच मॉडल प्राप्त होता था।

स्मृति हानि से पीड़ित एक एआई डॉक्टर

चैटजीपीटी हेल्थ ने इस “अस्पष्ट डेटा” को स्पष्ट चिकित्सा तथ्यों की तरह माना, जिसमें उस महत्वपूर्ण संदर्भ को गायब कर दिया गया जिसे एक मानव विशेषज्ञ तुरंत पहचान लेगा। यहां तक कि जब फाउलर ने डॉक्टर के कार्यालय से अपने आधिकारिक मेडिकल रिकॉर्ड को टूल से जोड़ा, तो ग्रेड केवल “5” (डी) तक सुधरा – यह और सबूत है कि मुख्य समस्या डेटा की मात्रा नहीं है, बल्कि एनालिटिक्स की कमी है।

विभिन्न चैट में, चैटजीपीटी बार-बार फाउलर के बारे में महत्वपूर्ण व्यक्तिगत जानकारी भूल गया, जिसमें उसका लिंग, उम्र और वर्तमान महत्वपूर्ण लक्षण शामिल थे। यहां तक कि जब एआई के पास उसके नवीनतम रक्त परीक्षण परिणामों तक पहुंच थी, तब भी वह कभी-कभी उन्हें विश्लेषण में शामिल करने में विफल रहा। व्यक्तिगत स्वास्थ्य संबंधी जानकारी प्रदान करने के उद्देश्य से बनाए गए टूल के लिए, यह एक मूलभूत दोष है। व्यक्ति की सतत समझ किसी भी सार्थक स्वास्थ्य मूल्यांकन की नींव है।

वर्गीकरण: एआई स्वास्थ्य के मामले में हम कहां खड़े हैं?

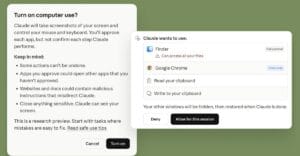

यह प्रयोग एक चिंताजनक प्रवृत्ति के साथ फिट बैठता है: प्रौद्योगिकी कंपनियां बाजार में ऐसे एआई उत्पाद ला रही हैं जो कम से कम सटीक हैं – या सबसे बुरी स्थिति में “खतरनाक” भी हैं। समस्या किसी भी तरह से OpenAI और ChatGPT हेल्थ तक सीमित नहीं है। एंथ्रोपिक के प्रतियोगी बॉट क्लाउड ने भी उसी त्रुटिपूर्ण तर्क पर भरोसा करते हुए फाउलर के हृदय स्वास्थ्य को “4” (डी) दर्जा दिया।

इसके अलावा, ये सेवाएँ अमेरिका में HIPAA जैसे सख्त स्वास्थ्य डेटा गोपनीयता कानूनों द्वारा कवर नहीं की जाती हैं। इसलिए यह प्रयोग एक महत्वपूर्ण चेतावनी है और भविष्य के लिए एक महत्वपूर्ण प्रश्न उठाता है: जब कोई एआई खराब स्वास्थ्य सलाह देता है तो हमें किस पर भरोसा करना चाहिए, और हम यह कैसे सुनिश्चित कर सकते हैं कि भविष्य के नवाचार सुरक्षित और विश्वसनीय हैं?

आप कैसे हैं? क्या आप पहले से ही स्वास्थ्य डेटा को ट्रैक करने या स्वास्थ्य समस्याओं को हल करने के लिए एआई का उपयोग कर रहे हैं?