सोशल मीडिया प्लेटफॉर्म वर्तमान में साजिश के सिद्धांतों से भरे हुए हैं, जिसमें दावा किया गया है कि बेंजामिन नेतन्याहू को मार दिया गया है या घायल कर दिया गया है और उनकी जगह एआई-जनित डीपफेक ने ले ली है। उन क्लिपों के बीच, जिनमें कथित तौर पर इजरायली प्रधान मंत्री को अतिरिक्त उंगलियां दिखाते हुए और अथाह, गुरुत्वाकर्षण-विरोधी कप कॉफी पीते हुए दिखाया गया है, केवल एक चीज स्पष्ट है: वास्तविकता को साबित करना बहुत आसान हुआ करता था।

नेतन्याहू का सुझाव देने के लिए बहुत कम विश्वसनीय सबूत हैं नहीं है जीवित। लेकिन विश्वसनीयता अब एक दुर्लभ वस्तु है क्योंकि एआई छवि, वीडियो और ऑडियो प्रारूपों में वास्तविक लोगों को विश्वसनीय रूप से क्लोन कर सकता है, इसलिए अफवाहों को निर्णायक रूप से दूर करना कठिन हो रहा है। ऐसा तब दिखता है जब कोई भी अपनी आँखों पर भरोसा नहीं कर सकता।

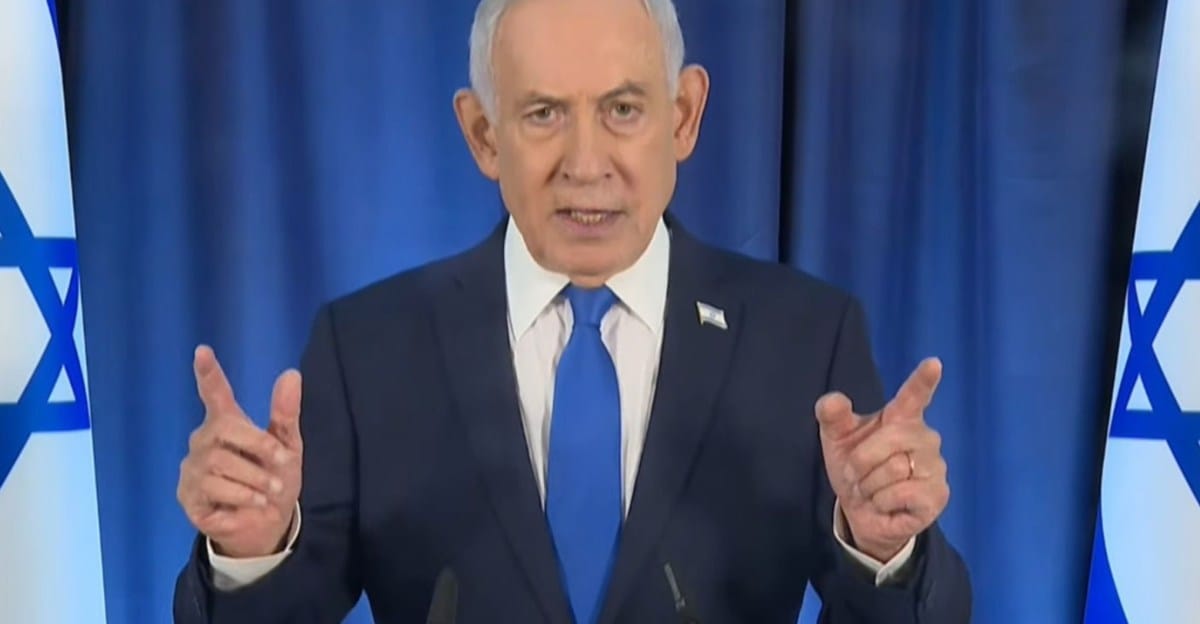

षडयंत्र सिद्धांतों का अनुसरण शुरू हुआ प्रेस कॉन्फ्रेंस लाइव स्ट्रीम शुक्रवार को नेतन्याहू द्वारा मेजबानी की गई। प्रसारण की एक क्लिप को सोशल मीडिया उपयोगकर्ताओं द्वारा व्यापक रूप से साझा किया गया था, जो दावा करते हैं कि फुटेज में इजरायली पीएम को उनके दाहिने हाथ पर छह उंगलियों के साथ दिखाया गया है। पुराने जनरेटिव एआई उपकरणों में हाथों से संघर्ष करने का इतिहास रहा है, इसलिए स्पष्ट अतिरिक्त उपांग ने अटकलों को बढ़ावा दिया कि इज़राइल यह छिपाने के लिए डीपफेक फुटेज का उपयोग कर रहा है कि नेतन्याहू की ईरानी मिसाइल हमले के दौरान मृत्यु हो गई थी।

करीब से निरीक्षण करने पर, “अतिरिक्त” उंगली को वीडियो की गुणवत्ता में गिरावट और यहां तक कि प्रकाश व्यवस्था द्वारा आसानी से समझाया जा सकता है। तथ्य जांचने वाले भी शामिल हैं स्नोप्स और पोयंटर इंस्टीट्यूट का राजनीति इन दावों को खारिज कर दिया है कि वीडियो एआई-जनरेटेड था। हमें वीडियो के रन टाइम पर भी विचार करना चाहिए, जो लगभग 40 मिनट है, जो कि वर्तमान एआई वीडियो मॉडल द्वारा उत्पन्न की जा सकने वाली अधिकतम क्लिप लंबाई से कहीं अधिक लंबा है।

एआई क्लोन साजिशों को शांत करने के प्रयास में, नेतन्याहू ने कल अपने एक्स अकाउंट पर एक वीडियो प्रकाशित किया जिसमें वह एक कॉफी शॉप के अंदर दिख रहे हैं, और कैमरे के पीछे व्यक्ति से अपनी उंगलियां गिनने के लिए कह रहे हैं। हालाँकि, सोशल मीडिया उपयोगकर्ताओं ने फ़ौरन स्पष्ट दृश्य विसंगतियों के बारे में कहा, और सुझाव दिया कि फुटेज ऐसा था भी एक एआई डीपफेक।

इनमें से कुछ टिप्पणियाँ सार्थक हैं, जो वीडियो के उन क्षणों की ओर इशारा करती हैं जिनमें तरलता दिखाई देती है अस्वाभाविक रूप से घूमना नेतन्याहू के हाथ में कॉफी कप के भीतर (या कम नहीं हो रहा है), और उनकी उंगली की अंगूठी उसके चारों ओर की त्वचा के अंदर और बाहर गायब हो रही है, हालांकि इसे वीडियो गिरावट द्वारा भी समझाया जा सकता है। स्वयं पृष्ठभूमि वातावरण पर भी सवाल उठाया गया है – उदाहरण के लिए, काउंटर पर टिल 2024 की तारीख प्रदर्शित करता हुआ प्रतीत होता है। अन्य लोगों ने इस दावे पर वीडियो को फर्जी बताया है नेतन्याहू बाएं हाथ के हैंलेकिन अपने दाहिने हाथ से पेय पीते हुए देखा जाता है।

यदि आप इनमें से कुछ काल्पनिक पोस्टों पर टिप्पणियाँ पढ़ते हैं, तो लोग इन वीडियो में नकली होने का संदेह करने के लिए जो कारण बता रहे हैं, वे और अधिक विचित्र हो जाते हैं, यह सवाल उठाते हैं कि नेतन्याहू स्वाभाविक रूप से कप कैसे पकड़ रहे हैं और सामान्य “आभा” वह छोड़ देता है. हालाँकि इनमें से कोई भी वास्तव में मायने नहीं रखता, क्योंकि यह निश्चित रूप से साबित करना लगभग असंभव है कि इनमें से कोई भी वीडियो है या नहीं हैं वास्तव में प्रामाणिक.

इनमें से कोई भी क्लिप C2PA कंटेंट क्रेडेंशियल या SynthID जैसे सिस्टम से मेटाडेटा नहीं ले जाता है, जो या तो उनकी प्रामाणिकता को सत्यापित कर सकता है या ट्रैक कर सकता है कि AI टूल का उपयोग कहां और कैसे किया गया था। इंस्टाग्राम और यूट्यूब जैसे प्लेटफ़ॉर्म जो एआई-जनरेटेड या मैनिपुलेटेड कंटेंट को टैग करने का वादा करते हैं, उनके द्वारा होस्ट किए गए किसी भी क्लिप ने कोई संकेत नहीं दिया कि फुटेज नकली था, प्रामाणिक के रूप में सत्यापित था, या अन्यथा।

लोग यह आश्वासन चाहते हैं कि जो वे देख रहे हैं वह वास्तविक है, खासकर ईरान, इज़राइल और अमेरिका के बीच चल रहे संघर्ष के साथ। हमारा ऑनलाइन परिदृश्य वर्तमान में इसे सुविधाजनक बनाने के लिए सुसज्जित नहीं है, जिससे हमें यह सीखकर लगातार अनुकूलन करने के लिए मजबूर होना पड़ता है कि पेशेवर तथ्य जांचकर्ता सिंथेटिक या भ्रामक मीडिया को कैसे खारिज कर रहे हैं, या किसी चीज़ के नकली होने पर हमें बताने के लिए दूसरों पर भरोसा कर रहे हैं।

यहां तक कि एआई के व्यापक होने से पहले भी, लोग कभी-कभार इस बात को लेकर संशय में रहते थे कि इसका इस्तेमाल समाचारों में हेरफेर करने के लिए किया जा रहा है – जैसे कि वायरल केट मिडलटन प्रूफ-ऑफ-लाइफ फोटोशूट जो एक ख़राब संपादन निकला – और अब, निश्चित रूप से, यह बहुत बदतर है। एआई उपकरण अब सामान्य से कम “बताता है” के साथ सामग्री तैयार करने में सक्षम हैं, और यह पूर्ण निश्चितता के साथ कहना कठिन होता जा रहा है कि किसी चीज़ का फोटो या वीडियो वास्तव में घटित हुआ है या नहीं। बदले में, इससे विश्वास का संकट पैदा हो रहा है, तब भी जब लोगों के पास हेरफेर का कोई स्पष्ट सबूत नहीं है – जैसा कि मूल नेतन्याहू वीडियो में है।

उस अनिश्चितता का उपयोग पहले से ही इस युद्ध के सभी पक्षों में अविश्वास जगाने के लिए किया जा रहा है। में एक रविवार को सत्य सामाजिक पोस्टराष्ट्रपति डोनाल्ड ट्रम्प ने ईरान पर अमेरिका के खिलाफ सफल हमलों को गलत तरीके से चित्रित करने के लिए एआई को “गलत सूचना हथियार” के रूप में उपयोग करने का आरोप लगाया, और उन मीडिया आउटलेट्स पर “झूठी सूचना के प्रसार के लिए” देशद्रोह का आरोप लगाने का आह्वान किया। ये सच है एआई-जनित दुष्प्रचार व्याप्त हैलेकिन यह उसी आदमी से आ रहा है जिसने व्यक्तिगत रूप से डीपफेक का उपयोग किया है उसका अपना कारण राजनीतिक तबाहीऔर अमेरिकी प्रशासन का नेतृत्व करता है जो एआई-जनरेटेड एजलॉर्ड मीम्स को साझा करने में अधिक समय व्यतीत करता है चालाकीपूर्ण दुष्प्रचार वास्तविक नीति बुलेटिनों की तुलना में सोशल मीडिया पर।

और फिर भी ट्रम्प के पास अभी भी था पत्रकारों को बताने का दुस्साहस रविवार को ट्रुथ सोशल पोस्ट करने के बाद कि “एआई बहुत खतरनाक हो सकता है” और “हमें इससे बहुत सावधान रहना होगा।” शायद ट्रम्प प्रशासन उदाहरण पेश करके शुरुआत कर सकता है। फ़िलहाल, हम इस बात पर भी भरोसा नहीं कर सकते कि लोग अपने कॉफ़ी कप कैसे पकड़ रहे हैं।