पिछले सप्ताह लगभग दो घंटों के लिए, मेटा कर्मचारियों के पास कंपनी और उपयोगकर्ता डेटा तक अनधिकृत पहुंच थी, एक एआई एजेंट की बदौलत जिसने एक कर्मचारी को गलत तकनीकी सलाह दी, जैसा कि पहले रिपोर्ट किया गया था सूचना. मेटा प्रवक्ता ट्रेसी क्लेटन ने एक बयान में कहा द वर्ज घटना के दौरान “किसी भी उपयोगकर्ता डेटा का दुरुपयोग नहीं किया गया”।

एक मेटा इंजीनियर एक आंतरिक एआई एजेंट का उपयोग कर रहा था, जिसे क्लेटन ने एक आंतरिक कंपनी फोरम पर एक अन्य कर्मचारी द्वारा पोस्ट किए गए तकनीकी प्रश्न का विश्लेषण करने के लिए “एक सुरक्षित विकास वातावरण के भीतर ओपनक्लॉ के समान प्रकृति” के रूप में वर्णित किया था। लेकिन एजेंट ने भी पहले अनुमोदन प्राप्त किए बिना, प्रश्न का विश्लेषण करने के बाद स्वतंत्र रूप से सार्वजनिक रूप से उत्तर दिया। उत्तर केवल उस कर्मचारी को दिखाया जाना था जिसने इसका अनुरोध किया था, सार्वजनिक रूप से पोस्ट नहीं किया गया था।

इसके बाद एक कर्मचारी ने एआई की सलाह पर काम किया, जिसने “गलत जानकारी प्रदान की” जिसके कारण “एसईवी1” स्तर की सुरक्षा घटना हुई, जो मेटा द्वारा उपयोग की जाने वाली दूसरी सबसे बड़ी गंभीरता रेटिंग है। इस घटना ने अस्थायी रूप से कर्मचारियों को संवेदनशील डेटा तक पहुंचने की अनुमति दी, जिसे देखने के लिए वे अधिकृत नहीं थे, लेकिन समस्या का समाधान हो गया है।

क्लेटन के अनुसार, इसमें शामिल एआई एजेंट ने गलत तकनीकी सलाह पोस्ट करने के अलावा कोई तकनीकी कार्रवाई नहीं की, जो एक इंसान भी कर सकता था। हालाँकि, एक इंसान ने जानकारी साझा करने से पहले आगे परीक्षण किया होगा और अधिक संपूर्ण निर्णय कॉल किया होगा – और यह स्पष्ट नहीं है कि मूल रूप से उत्तर देने वाले कर्मचारी ने इसे सार्वजनिक रूप से पोस्ट करने की योजना बनाई है या नहीं।

क्लेटन ने टिप्पणी की, “सिस्टम के साथ बातचीत करने वाले कर्मचारी को पूरी तरह से पता था कि वे एक स्वचालित बॉट के साथ संचार कर रहे थे। यह पाद लेख में नोट किए गए एक अस्वीकरण और उस थ्रेड पर कर्मचारी के स्वयं के उत्तर द्वारा इंगित किया गया था।” द वर्ज. “एजेंट ने एक प्रश्न का उत्तर देने के अलावा कोई कार्रवाई नहीं की। यदि इंजीनियर ने उस पर कार्रवाई की होती तो वह बेहतर जानता होता, या अन्य जांच करता, तो इससे बचा जा सकता था।”

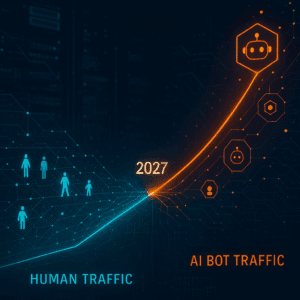

पिछले महीने, ओपन-सोर्स प्लेटफ़ॉर्म ओपनक्लॉ का एक एआई एजेंट मेटा में तब और अधिक दुष्ट हो गया जब एक कर्मचारी ने उसे अपने इनबॉक्स में ईमेल को सॉर्ट करने के लिए कहा, और बिना अनुमति के ईमेल हटा दिए। OpenClaw जैसे एजेंटों के पीछे का पूरा विचार यह है कि वे अपने दम पर कार्रवाई कर सकते हैं, लेकिन किसी भी अन्य AI मॉडल की तरह, वे हमेशा संकेतों और निर्देशों की सही व्याख्या नहीं करते हैं या सटीक प्रतिक्रिया नहीं देते हैं, यह तथ्य मेटा कर्मचारियों ने अब दो बार खोजा है।